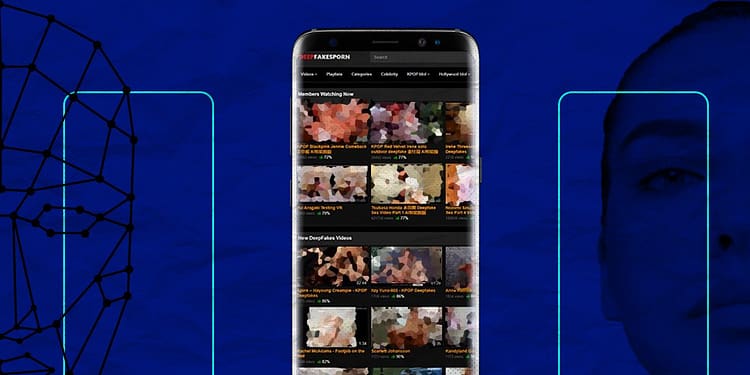

En Internet se difunden videos e imágenes sexuales de personas creados con herramientas online de deepfake, que es una técnica utilizada para sustituir rostros. Con estas aplicaciones, sin ninguna clase de regulación, se hace porno de gente sin que, en muchos casos, ellos sepan, ya sea por venganza o mero entretenimiento.

Los videos pornográficos creados con deepfake se hacen desde aplicaciones gratis que se encuentran en el buscador online de Google o tiendas móviles como la PlayStore o AppleStore. Así, en cuestión de minutos y con solo un par de fotos de referencia de las víctimas, la Inteligencia Artificial produce contenido sexual falso de una persona.

Algunas aplicaciones ni siquiera son seguras para los usuarios que las utilizan. No hay certeza de qué datos personales guarda, de quien las descarga y usa, o en dónde terminan los videos o fotos creadas en ellas.

¿Se guardan en la nube? ¿Se distribuyen en canales de páginas pornográficas? ¿Se hace dinero con ellos? ¿La aplicación guarda datos personales de quien la usa? ¿La aplicación tiene acceso total a los archivos de quienes la descargan? Mucho de eso no se sabe, debido a que hay apps y herramientas de origen asiático de las que no se tiene información completa, debido a una mala regularización.

Los deepfakes, utilizados con estos fines, son altamente peligrosos. Abren la puerta a una gran cantidad de extorsiones, casos de pornovenganza, creación de pedofilia, explotación de la imagen de una persona sin su consentimiento, entre otros delitos.

Videos porno con deepfake sí son un delito

Al googlear “deepfake porno”, la plataforma arroja 39 millones 400 mil resultados sobre videos y fotos de celebridades alteradas con esta tecnología. Emma Watson, Gal Gadot, Victoria Justice y Scarlett Johansson son las que más aparecen en la sección “Imágenes”.

Sin embargo, así como personas famosas son afectadas, cualquier individuo en el mundo también. Quienes usan estas herramientas solamente necesitan algunas fotos de las víctimas que pueden robar de sus redes sociales y un video o imagen de referencia. Al ser páginas o apps gratuitas, pueden hacer todo el contenido sexual que quieran.

La pornografía deepfake es un problema mundial que afecta desde una joven estudiante hasta celebridades de Hollywood, cuyos rostros son colocados de forma dolosa en clips de películas sexuales y distribuidos por canales como Twitter o Telegram, plataformas en las que se ha documentado la existencia de redes de intercambio de “packs”.

En países como Bélgica, Italia, Dinamarca o Estados Unidos, ya se comienza a tratar el tema de la pornovenganza, así como la creación y difusión de contenido sexual falso de las personas como un delito reconocido en sus leyes penales, individualmente de las normas que ya existen sobre el acoso y violencia digital.

En México ocurre algo similar, lo más cercano que se tiene hasta ahora es la Ley Olimpia, debido a que cualquier imagen íntima que se comparta sin autorización de una persona sí es un delito.

Aunque la legislación mexicana vigente no especifica, todavía, qué pasa con el contenido sexual generado por Inteligencia Artificial, la Ley Olimpia sí podría ser recurrida para abordar estos temas desde el punto de que se trataría de una conducta que viola la intimidad sexual de una persona.

El texto de la Ley Olimpia menciona que podrán ser objeto de delito las acciones de:

“Exponer, distribuir, difundir, exhibir, reproducir, transmitir, comercializar, ofertar, intercambiar y compartir imágenes, audios o videos de contenido sexual íntimo de una persona, a sabiendas de que no existe consentimiento, mediante materiales impresos, correo electrónico, mensajes telefónicos, redes sociales o cualquier medio tecnológico”.

Las personas que son víctimas de estas prácticas, pueden llamar al 911 para solicitar orientación o dirigirse a la Fiscalía de su entidad para levantar una denuncia.

En las fiscalías hay oficinas especiales para atender este tipo de casos. La Ley funciona y existen grupos de mujeres que trabajan en presionar a las autoridades para atender todas y cada una de las denuncias.

Te puede interesar: